El último deepfake de Stranger Things es tan alucinante que demuestra que la realidad empieza a ser opcional

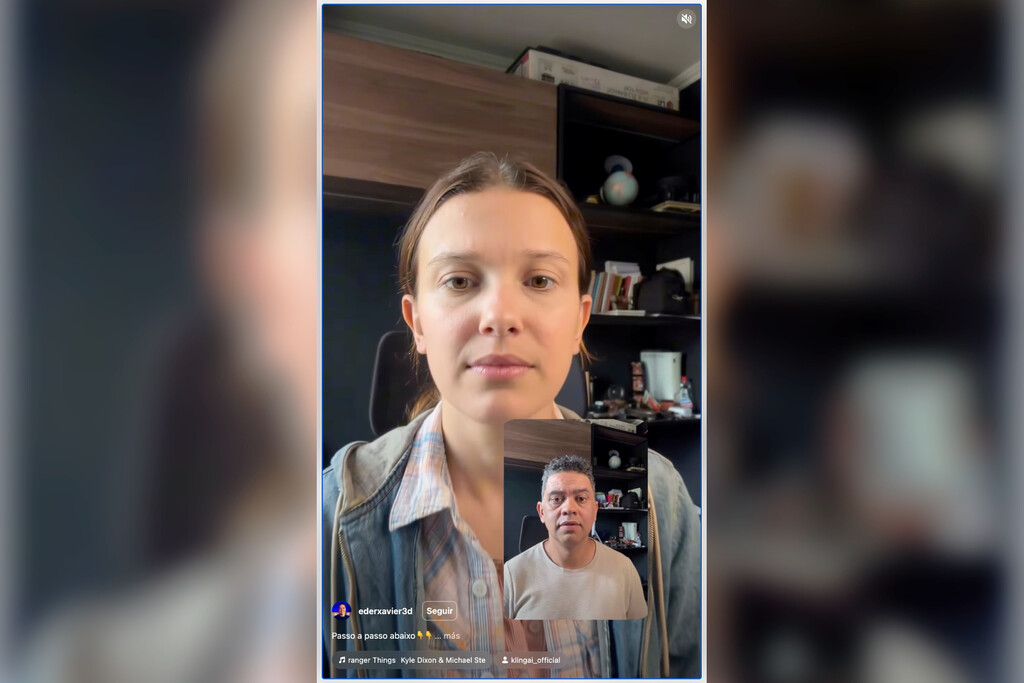

Esta semana, un creador de contenidos brasileño llamado ederxavier3d publicó un alucinante vídeo en su cuenta de Instagram. En él aparecían varios de los protagonistas de la serie 'Stranger Things' haciendo justo los gestos y expresiones que él hacía en la ventana inferior. Él explicaba que lo había logrado de forma sencilla y gracias al nuevo Kling 2.6 y su característica Motion Control . Esa opción permite que los movimientos que hacemos en un vídeo se trasladen a cualquier persona real o ficticia, sea cual sea el estilo en el que está representada (puede ser un personaje de cómic) con un resultado asombroso. Ver esta publicación en Instagram Una publicación compartida de Eder Xavier | Archviz e IA para Arquitetura (@ederxavier3d) Y en el caso del vídeo del creador brasileño se puede ver claramente: esos vídeos podrían pasar perfectamente por reales en casi todos los casos. Es cierto que si uno se fija puede intuir que algo falla, pero solo porque el vídeo ha sido compartido dejando claro que está creado con IA. Dicho vídeo ha vuelto a despertar un debate que lleva tiempo ligado a este tipo de deepfakes. Justine Moore, socia de la firma de inversión a16z, explicaba que "no estamos preparados por lo rápido que los flujos de producción [de vídeo] van a cambiar con la IA. Algunos de los últimos modelos de vídeo tienen implicaciones inmediatas para Hollywood. Intercambios interminables de personajes a costes insignificantes". En Xataka Android He puesto a Veo 3.1 y Sora 2 frente a frente creando vídeos. La frontera con la realidad es cada vez más difusa Cómo ha cambiado el cuento. En abril de 2023 os proponíamos a todos los que nos leéis un pequeño juego: ¿seríais capaces de distinguir una imagen real de una generada por IA? En aquel momento la IA ya lograba resultados destacables —la imagen del Papa con el abrigo lo demostró— pero la sensación era la de que aún podíamos distinguir si una imagen había sido creada con una IA o no. Con el vídeo la cosa estaba aún más clara , porque por entonces la generación de vídeo por IA estaba en pañales . Tres años después la cosa es muy distinta, y son varias las plataformas de IA ( Veo 3 , Sora 2 , Kling, Runway) que generan vídeos que cualquiera podría confundir fácilmente sin problemas. Que se lo digan a Will Smith . El vídeo de ederxavier3d también lo demuestra, y de hecho con él ocurrió algo singular: hubo rumores de que en realidad los personajes de Stranger Things habían grabado esas apariciones y el creador había imitado sus movimientos, y después aparecieron rumores que negaban que eso fuera cierto y que apuntaban a que desde el principio los vídeos no eran más que lo que parecían: deepfakes creados con IA. A priori todo haría pensar que así es: la característica de Kling 2.6 no es en absoluto nueva y otras plataformas permiten que nuestros movimientos y gestos —e incluso nuestra voz— se trasladen a un personaje generado por IA. El problema es que a estas alturas ya es casi imposible distinguir si efectivamente esa persona que aparece en pantalla es real o no. Esta tecnología es extraordinariamente llamativa y provoca ese "efecto wow" que tanto buscan las empresas de IA, pero a pesar de las opciones creativas que ofrece, aquí los riesgos parecen especialmente notables. En Xataka Los deepfakes son mucho más que una broma de mal gusto. Ahora el Gobierno quiere que sean una vulneración del derecho al honor La suplantación de identidad es ahora más sencilla de lograr que nunca, y eso hará que probablemente veamos muchos más casos peligrosos. Basta recordar al empleado que transfirió 25 millones de dólares creyendo que quien se lo decía por videoconferencia era su jefe de verdad. No está claro cómo reaccionarán por ejemplo los estudios de Hollywood ante esta tecnología, pero de momento algunos ya están tomando cartas en el asunto para intentar protegerse. El mejor ejemplo es Matthew McConaughey, que estos días se ha "patentado a sí mismo" para tener un recurso legal más (que no estamos seguros de que haga falta) para protegerse ante posibles vídeos suplantándole. Las implicaciones son enormes, y estamos asomándonos a una era en la que va a pasar algo inquietante: no podremos fiarnos de lo que vemos en una pantalla . En Xataka | "Hola, soy tu nieto y necesito 3.000 dólares": ya hay estafas a ancianos con voces generadas por IA - La noticia El último deepfake de Stranger Things es tan alucinante que demuestra que la realidad empieza a ser opcional fue publicada originalmente en Xataka por Javier Pastor .