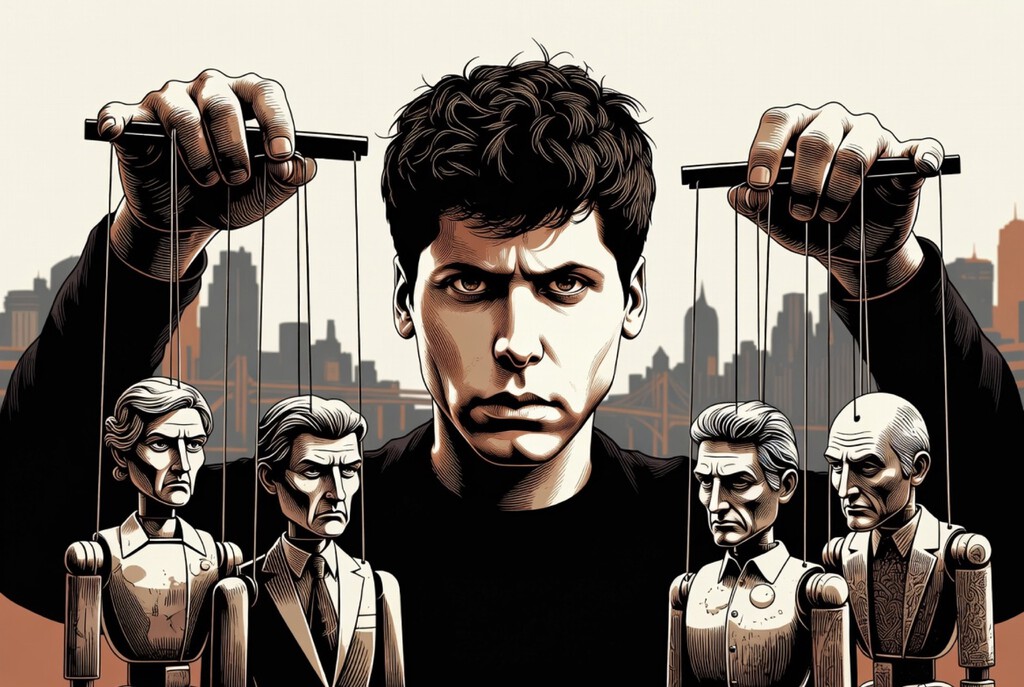

Sam Altman dice que le aterroriza un mundo donde las empresas de IA se crean más poderosas que el gobierno. Es justo lo que está construyendo

Sam Altman se sentó el fin de semana ante su audiencia en X para responder preguntas sobre el acuerdo que OpenAI acaba de firmar con el Departamento de Guerra de Estados Unidos . Lo que salió de esa sesión fue una hermosa radiografía involuntaria de la contradicción más grande del sector en estos momentos. Por qué es importante . El CEO de OpenAI dijo que le aterra "un mundo donde las empresas de IA actúen como si tuvieran más poder que el gobierno." La frase suena bien, es marketiniana y busca elevar la posición de OpenAI como un grupo poderoso pero muy responsable y honesto. El problema es el contexto en que la pronuncia: horas antes de que OpenAI firmara ese acuerdo, el gobierno estadounidense etiquetó a Anthropic, su rival directo, como un "riesgo para la cadena de suministro" por negarse a firmar en esas mismas condiciones. Altman acudió a apagar el fuego justo cuando alguien le acusaba de haberlo prendido. En Xataka OpenAI ha colado su IA en el Pentágono. Ahora apunta a un objetivo mayor: las redes clasificadas de la OTAN Entre líneas . El discurso de Altman descansa sobre una premisa que debe ser fiscalizada: que un gobierno democráticamente elegido siempre debe prevalecer sobre empresas privadas no electas. Es una posición filosóficamente razonable, pero él la aplica de forma selectiva. Altman reconoció que el acuerdo "fue apresurado y la imagen no es buena", y que OpenAI se movió rápido para "desescalar" la tensión entre el Pentágono y la industria. Dicho de otro modo: su empresa tomó una decisión estratégica unilateral sobre cómo debería relacionarse toda la industria de la IA con el estamento militar. Eso no parece exactamente deferencia institucional. El contraste . Anthropic optó por algo diferente: exigir garantías explícitas contra el uso de su IA para vigilancia masiva o armas autónomas. Pero el gobierno la penalizó. OpenAI aceptó una fórmula más ambigua ("para todos los usos legales") y obtuvo el contrato. Varios empleados de OpenAI firmaron una carta apoyando la postura de Anthropic . Claude se convirtió ese fin de semana en la aplicación gratuita más descargada de la App Store de Apple, superando precisamente a ChatGPT. El mercado también tiene opiniones. Sí, pero . Es justo admitir que la posición de Altman tiene cierta lógica interna: Si la IA va a integrarse en sistemas militares de todos modos, puede ser preferible que lo haga bajo condiciones negociadas antes que bajo coerción. Y tiene razón en una cosa: el etiquetado de Anthropic como riesgo para la cadena de suministro, una herramienta pensada para proveedores extranjeros hostiles, aplicada a una empresa americana de seguridad en IA es, en sus propias palabras, "un precedente extremadamente aterrador." La gran pregunta . ¿Quién decide realmente cómo se usa la IA en contextos militares? ¿Las empresas que la construyen, los gobiernos que la contratan, o los ingenieros que la diseñan y que cada vez se organizan más para influir en esas decisiones? Altman dice creer en el proceso democrático. Pero OpenAI negoció en privado, firmó en privado e hizo pública únicamente solo una fracción del contrato. La transparencia democrática empieza por ahí. En Xataka | Anthropic se ha convertido en la Apple de nuestra era y OpenAI en nuestra Microsoft: una historia de amor y odio Imagen destacada | Xataka - La noticia Sam Altman dice que le aterroriza un mundo donde las empresas de IA se crean más poderosas que el gobierno. Es justo lo que está construyendo fue publicada originalmente en Xataka por Javier Lacort .