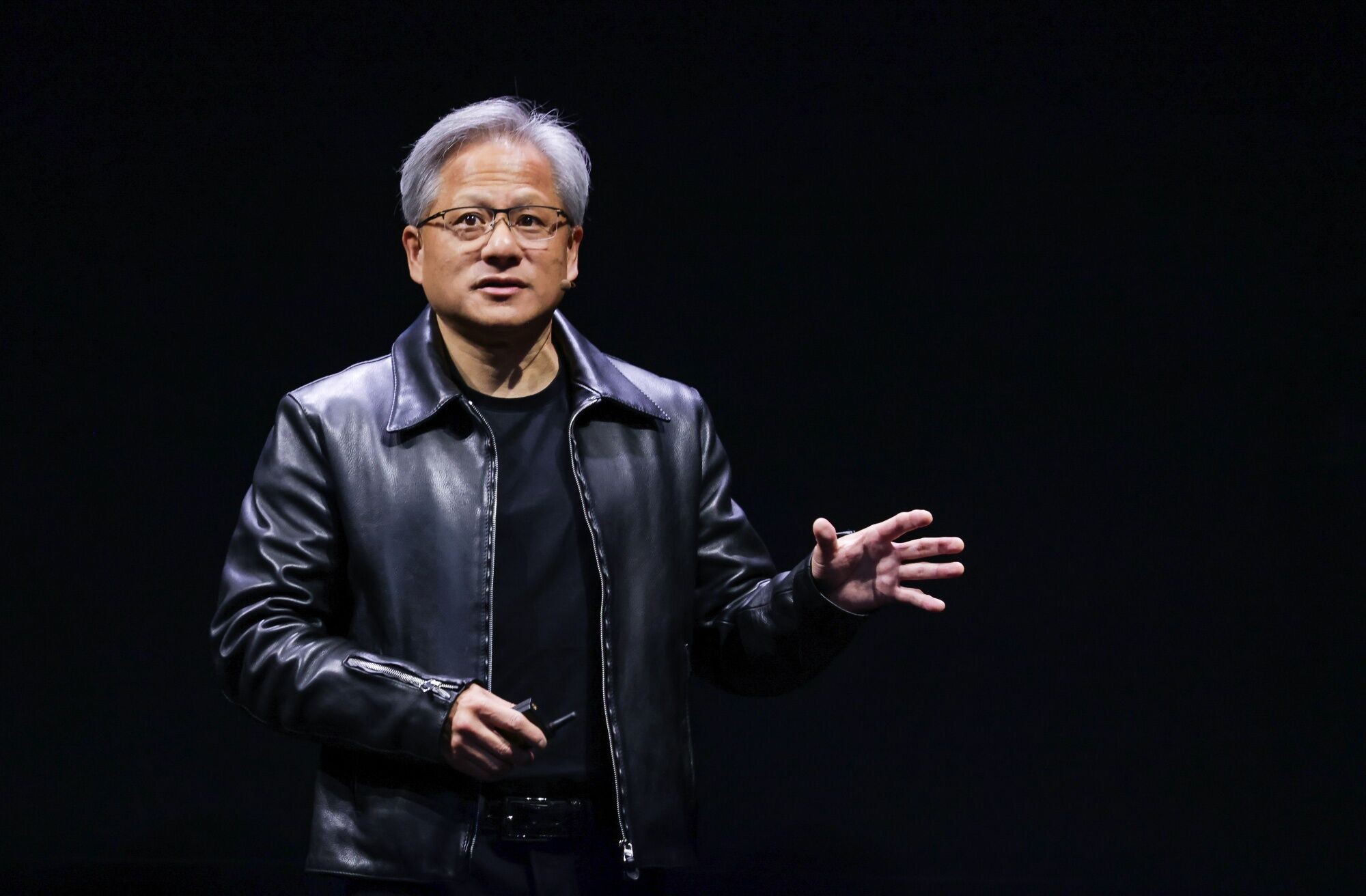

CEO de Nvidia diz que é contra alarmar o público sobre a inteligência artificial

O CEO da Nvidia, Jensen Huang, disse que os líderes do setor de tecnologia devem ter cuidado para não assustar as pessoas em relação à inteligência artificial, em resposta a uma pergunta sobre como a Anthropic poderia ter gerido melhor as complicadas negociações contratuais com o Pentágono. “O desejo de alertar as pessoas sobre a capacidade da tecnologia é realmente fantástico”, disse Huang durante uma mesa-redonda na conferência tecnológica da empresa. “Alertar está bem, assustar nem tanto, porque esta tecnologia é importante demais para nós.” Por trás dessa posição está a convicção de Huang de que o maior risco para a segurança nacional dos EUA em relação à IA é que os americanos fiquem tão irritados, assustados ou paranoicos que o país adote a tecnologia mais lentamente do que seus rivais. A Anthropic, um dos principais clientes da Nvidia e criadora do chatbot Claude, continua envolvida em um conflito com a administração Trump por causa das restrições que a empresa buscava impor ao uso militar de suas ferramentas de IA. A relação da Anthropic com o Pentágono se rompeu no mês passado devido à insistência do diretor executivo, Dario Amodei, em incluir cláusulas contratuais que proibissem o uso de seus produtos para vigilância interna dos americanos e para armas totalmente autônomas. Em resposta, a administração Trump declarou a Anthropic um risco para a cadeia de suprimentos e tomou medidas para excluí-la de projetos em todo o governo — medidas que a empresa agora contesta nos tribunais. Apesar da disputa, Huang se mostrou otimista em relação às perspectivas financeiras da Anthropic. Durante o painel, que se tornou um episódio do podcast All-In focado em tecnologia, Huang afirmou que acredita que a receita da Anthropic poderia ultrapassar US$ 1 trilhão em 2030. Ele acrescentou que, em sua opinião, Amodei foi conservador em suas previsões. Os porta-vozes da Anthropic não responderam imediatamente a um pedido de comentário. Quando questionado especificamente sobre o que faria se estivesse no conselho da Anthropic, Huang primeiro expressou sua admiração pela empresa, incluindo seu foco em segurança e proteção, e depois disse que a indústria deve ter cuidado para não alimentar um medo desnecessário em relação às ferramentas de IA. “Não é um ser biológico. Não é um extraterrestre. Não tem consciência. É um programa de computador”, disse Huang. “Dizer coisas bastante extremas, bastante catastróficas, sem evidências de que vão acontecer, pode ser mais prejudicial do que as pessoas pensam.”