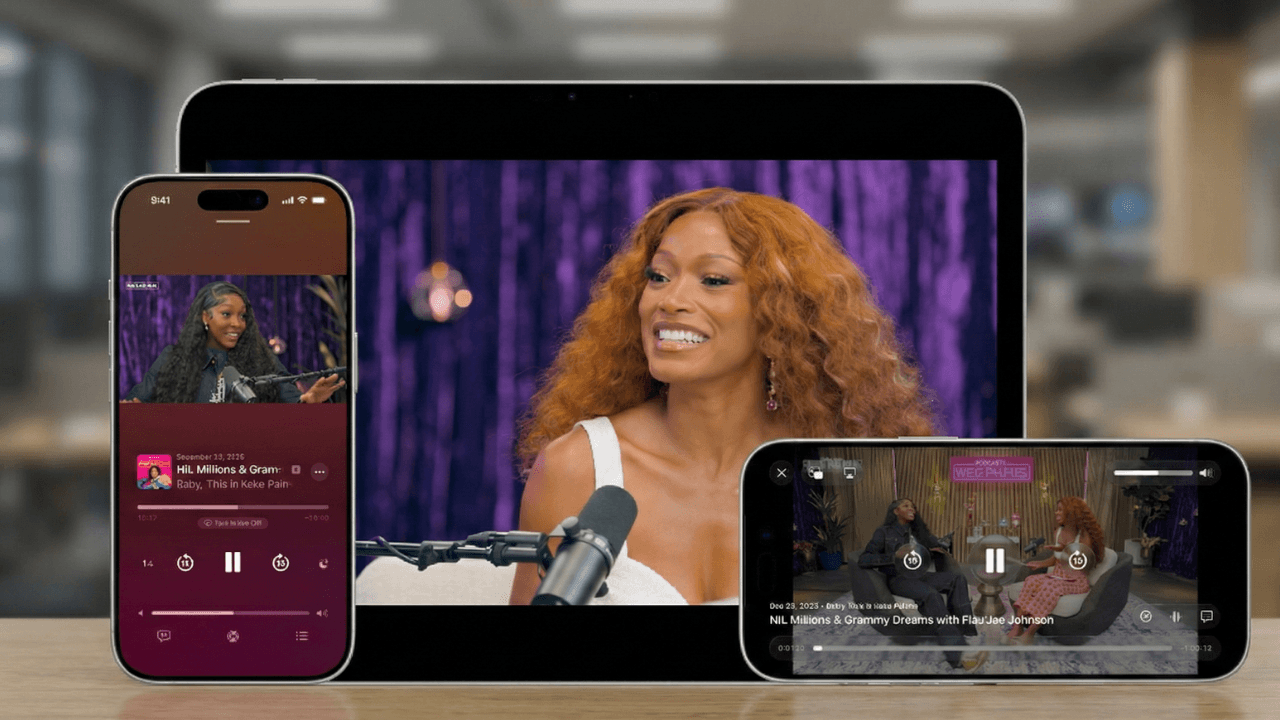

Apple Podcasts Video İçerikleri ile Deneyimi Değiştiriyor

Apple, podcast ekosistemini iTunes döneminde popüler hale getirmesinin ardından şimdi yeni bir dönüşümün kapısını aralıyor. Şirket, bu baharda Apple Podcasts uygulamasına eklenecek gelişmiş “Video Podcast” özelliklerini tanıtarak kullanıcıların içerik izleme ve dinleme alışkanlıklarını kökten değiştirmeyi hedefliyor. Apple Podcasts Video İçerikleri ve Yeni Özellikler Apple, popüler sesli içerik platformunu yeni nesil yayıncılık anlayışına uygun şekilde güncelliyor. […]